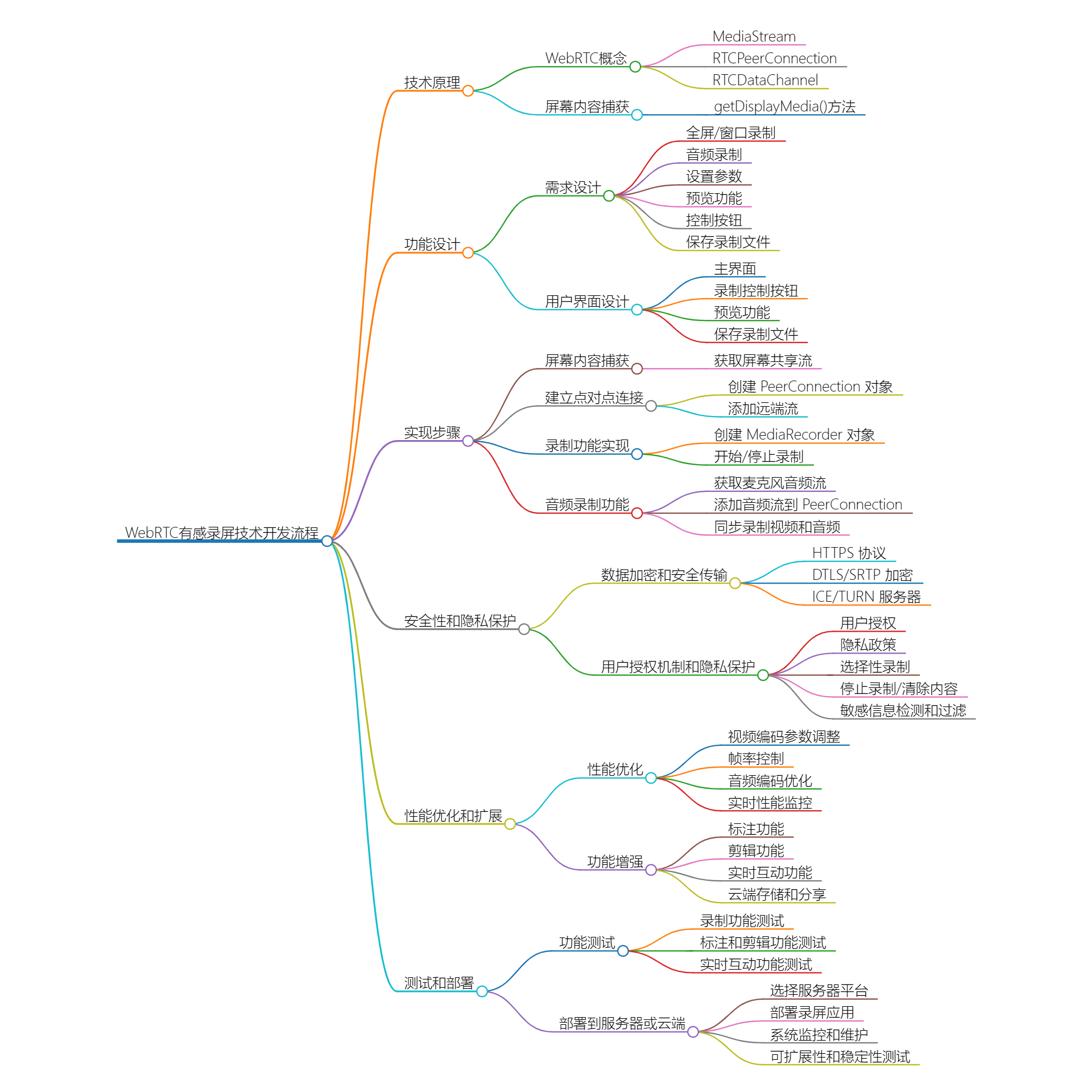

第一章:技术原理

WebRTC(Web Real-Time Communication)是一种开放源代码项目,旨在通过浏览器之间的点对点通信实现实时音视频通信。WebRTC利用JavaScript API在浏览器中实现多媒体通信,无需安装插件或第三方软件。

在线录屏 | 一个覆盖广泛主题工具的高效在线平台(amd794.com)

https://amd794.com/recordscreen

WebRTC的基本原理涉及三个主要组件:MediaStream、RTCPeerConnection和RTCDataChannel。MediaStream用于捕获音频和视频数据,RTCPeerConnection用于建立点对点连接并传输媒体流,RTCDataChannel用于传输任意数据。

实时音视频通信的方式通常包括以下步骤:

获取本地媒体流:使用getUserMedia()方法获取本地音频和视频流。

建立连接:通过RTCPeerConnection建立点对点连接,包括ICE(Interactive Connectivity Establishment)协议用于穿越NAT和防火墙,以及SDP(Session Description Protocol)用于描述媒体流信息。

传输媒体流:将本地媒体流通过addTrack()方法添加到RTCPeerConnection中,同时接收远程媒体流。

控制网络传输:使用RTCP(Real-Time Control Protocol)监控网络状态,实现带宽适应和丢包恢复。

使用MediaStream API捕获屏幕内容

MediaStream API提供了getDisplayMedia()方法,用于捕获屏幕、应用窗口或浏览器标签的内容。通过调用getDisplayMedia() 方法并传入适当的参数,可以选择捕获整个屏幕或特定应用窗口,并获取对应的MediaStream对象。

比如,以下代码演示如何捕获整个屏幕的内容:

navigator.mediaDevices.getDisplayMedia({video: true})

.then(stream => {

// 处理获取到的屏幕内容流

})

.catch(error => {

console.error('Error capturing screen:', error);

});

RTCPeerConnection实现屏幕内容的实时传输

RTCPeerConnection用于在浏览器之间建立点对点连接并传输媒体流。要实现屏幕内容的实时传输,首先需要获取屏幕内容的MediaStream对象,然后将其添加到RTCPeerConnection中。

以下是一个简单的示例代码,演示如何将屏幕内容的MediaStream添加到RTCPeerConnection中:

const peerConnection = new RTCPeerConnection();

navigator.mediaDevices.getDisplayMedia({video: true})

.then(stream => {

stream.getTracks().forEach(track => {

peerConnection.addTrack(track, stream);

});

})

.catch(error => {

console.error('Error capturing screen:', error);

});

通过理解WebRTC的基本原理、MediaStream API的使用和RTCPeerConnection的实现,可以实现屏幕内容的实时传输,为实时音视频通信提供更多可能性。

第二章:功能设计

有感录屏技术功能需求设计

全屏录制:支持录制整个屏幕的内容,包括所有显示的应用程序窗口和桌面操作。

应用窗口录制:允许用户选择特定的应用程序窗口进行录制,而不是整个屏幕。

音频录制:能够同时录制系统音频和麦克风音频,以记录屏幕操作时的声音。

录制参数设置:提供设置录制分辨率、帧率、音频输入源等参数的选项,以满足用户不同的录制需求。

实时预览:在录制过程中提供实时预览功能,让用户可以即时查看录制内容,确保录制效果符合预期。

录制开始/停止按钮:设计明确的开始和停止录制按钮,方便用户控制录制的启动和结束。

保存录制文件:支持保存录制的视频文件,并允许用户选择保存路径和文件格式。

用户界面设计

主界面:主界面应简洁直观,包括全屏录制、应用窗口录制、音频录制等功能按钮,以及设置参数和预览窗口。

录制控制按钮:设计明显的开始录制和停止录制按钮,使用户可以轻松地启动和停止录制过程。

预览功能:在录制过程中显示实时预览窗口,让用户随时查看录制内容,确保录制效果符合期望。

保存录制文件:提供保存录制文件的按钮,并允许用户在保存之前选择保存路径和文件格式。

实时传输和延迟控制

实时传输:确保录制内容能够实时传输到目标存储位置或播放设备,以便用户能够及时查看录制的内容。

延迟控制:通过优化录制和传输过程,降低延迟,确保录制内容的实时性和流畅性。

第三章:实现步骤

步骤一:捕获屏幕内容

使用getDisplayMedia方法获取屏幕共享流,该方法可以捕获整个屏幕或特定应用窗口。

const stream = await navigator.mediaDevices.getDisplayMedia({video: true});

步骤二:建立点对点连接

创建 PeerConnection 对象,建立与另一端的连接。

const configuration = {iceServers: [{urls: 'stun:stun.l.google.com:19302'}]};

const peerConnection = new RTCPeerConnection(configuration);

添加远端流到 PeerConnection 中。

stream.getTracks().forEach(track => peerConnection.addTrack(track, stream));

步骤三:实现录制功能

创建一个 MediaRecorder 对象,用于录制视频流。

let recordedChunks = [];

const mediaRecorder = new MediaRecorder(stream);

mediaRecorder.ondataavailable = event => {

if (event.data.size > 0) {

recordedChunks.push(event.data);

}

};

mediaRecorder.onstop = () => {

const recordedBlob = new Blob(recordedChunks, {type: 'video/webm'});

// 处理录制完成后的视频数据

};

开始录制并停止录制。

mediaRecorder.start();

// 停止录制

mediaRecorder.stop();

步骤四:添加音频录制功能

获取麦克风音频流。

const audioStream = await navigator.mediaDevices.getUserMedia({audio: true});

将音频流添加到 PeerConnection 中。

audioStream.getAudioTracks().forEach(track => peerConnection.addTrack(track, audioStream));

在录制视频时同时录制音频。

const mediaRecorder = new MediaRecorder(stream, {mimeType: 'video/webm; codecs=opus'});

通过以上步骤,您可以基于 WebRTC 实现有感录屏技术,包括捕获屏幕内容、建立点对点连接、实现录制功能和添加音频录制功能。请注意,以上代码仅为示例,实际应用中可能需要根据具体需求进行调整和优化。

第四章:安全性和隐私保护

为确保传输过程中的安全性和用户隐私,以及提供用户选择性录制的功能,我们可以采取以下措施:

数据加密和安全传输

使用 HTTPS 协议来保护数据传输过程中的安全性,确保数据在传输过程中受到加密保护。

在 WebRTC 中,可以使用 DTLS(Datagram Transport Layer Security)和 SRTP(Secure Real-time Transport Protocol)来加密数据传输,确保音视频数据的安全性。

在建立 PeerConnection 时,可以配置合适的 ICE 服务器和 TURN 服务器,以确保数据传输的稳定性和安全性。

用户授权机制和隐私保护

在应用中实现用户授权机制,确保用户在开始录制屏幕内容之前进行明确的授权操作。可以使用浏览器的权限请求 API 来请求用户的屏幕共享和音频录制权限。

提供明确的隐私政策和用户协议,向用户说明数据的使用目的和安全保障措施,让用户了解其数据的去向和使用方式。

在录制过程中,应提供用户选择性录制的功能,让用户可以选择录制整个屏幕、特定应用窗口或区域,避免录制敏感信息。

在录制过程中,应提供停止录制的功能,让用户随时可以终止录制并清除已录制的内容,以保护用户隐私。

对录制的内容进行敏感信息检测和过滤,确保不会录制或传输包含敏感信息的内容,如密码、银行卡信息等。

通过以上措施,可以有效确保传输过程中的安全性和用户隐私,同时提供用户选择性录制的功能,避免录制敏感信息,从而提升用户体验和数据安全性。

第五章:性能优化和扩展

要优化录屏技术的性能,包括视频编码参数调整、帧率控制等,以及添加标注、剪辑、实时互动等功能,可以考虑以下方法:

优化录屏技术性能

视频编码参数调整:

选择合适的视频编码器和编码参数,如 H.264、H.265 等,根据需求调整比特率、分辨率、帧率等参数,以平衡视频质量和性能消耗。

考虑使用硬件加速编码器,如 GPU 加速,以提高编码效率和降低 CPU 负载。

帧率控制:

根据录屏内容的动态性和实际需求,调整帧率设置,避免过高的帧率导致性能消耗过大。

可以实现动态帧率控制,根据内容变化自动调整帧率,以平衡性能和视频流畅度。

优化音频编码:

选择适合的音频编码器和参数,确保音频质量和性能消耗的平衡。

考虑音频流的压缩和降噪处理,以提高录制音频的质量。

实时性能监控:

实时监控录屏应用的性能指标,如 CPU 使用率、内存占用等,及时发现性能瓶颈并进行优化。

增强录屏应用的功能

添加标注功能:

提供用户在录制过程中添加文字、箭头、形状等标注工具,方便用户标记关键信息或进行说明。

支持标注的保存和导出,以便用户在录制后进行查看或分享。

剪辑功能:

提供用户在录制后对视频进行剪辑、裁剪、合并等操作,以精炼视频内容。

支持添加过渡效果、音频替换等功能,提升视频的观赏性和专业性。

实时互动功能:

支持实时画面标注、实时聊天、实时反馈等功能,增强用户与观众或参与者之间的互动性。

可以集成实时投票、问答等功能,提升录屏内容的参与度和互动性。

云端存储和分享:

提供云端存储和分享功能,让用户可以轻松保存录制内容并分享给他人,增强应用的实用性和便捷性。

通过优化录屏技术的性能和增强录屏应用的功能,可以提升用户体验,增强应用的实用性,并满足用户对于录屏工具的更多需求。

第六章:测试和部署

要确保录制功能的稳定性和可靠性,以及部署有感录屏技术到服务器或云端并提供在线录屏服务,可以按以下步骤进行:

功能测试

录制功能测试:

确保录制功能在不同操作系统和设备上的稳定性和兼容性,包括录制开始、暂停、结束等操作。

测试录制过程中的视频质量、音频质量、帧率等参数,确保录制效果符合预期。

进行长时间录制测试,检查是否存在内存泄漏或性能下降等问题。

标注和剪辑功能测试:

测试标注和剪辑功能的稳定性和准确性,包括添加标注、剪辑视频、保存和导出等操作。

确保标注和剪辑功能与录制功能的集成性和兼容性。

实时互动功能测试:

测试实时画面标注、实时聊天、实时反馈等功能的实时性和稳定性。

确保实时互动功能与录制功能的协同工作正常,不会影响录制过程。

部署有感录屏技术到服务器或云端

选择合适的服务器或云端平台:

根据需求选择合适的服务器提供商或云端平台,考虑性能、可扩展性、安全性等因素。

部署录屏应用:

将有感录屏技术部署到服务器或云端,确保配置正确、服务正常运行。

配置服务器环境,包括数据库、存储、网络等,以支持在线录屏服务。

系统监控和维护:

配置监控系统,实时监测服务器和应用的性能和运行状态,及时发现和解决问题。

定期进行系统维护和更新,确保系统的稳定性和安全性。

可扩展性和稳定性测试:

测试服务器或云端部署的录屏服务的可扩展性,包括负载均衡、容灾备份等方面。

进行压力测试和性能测试,确保系统在高负载情况下仍能保持稳定运行。

通过功能测试和部署到服务器或云端,可以确保有感录屏技术的在线录屏服务稳定可靠,同时保证系统的可扩展性和稳定性,为用户提供优质的录屏体验。